동영상을 분석해 특정 인물이나 물체가 어떤 행동을 하고 있는지를 식별해 낼 수 있는 시각지능 기술이 개발된다. 시각 및 영상 정보를 활용하는 미래 산업 전반에 폭넓게 활용할 수 있는 기술이다.

한국전자통신연구원(ETRI·원장 이상훈)이 인공지능(AI)을 활용해 영상 속 사람이나 물체를 식별하고 행동에 담긴 의미를 추론하는 `시각지능` 기술을 개발한다고 30일 밝혔다. 내년 상용화가 목표다.

박경 ETRI 시각지능연구그룹장은 “올해 안에 원천 기술을 확보한다는 목표로 AI를 영상 분야에 적용, 정보를 파악하고 내용을 분석하는 시각지능 기술 `딥뷰`를 개발하고 있다”고 밝혔다.

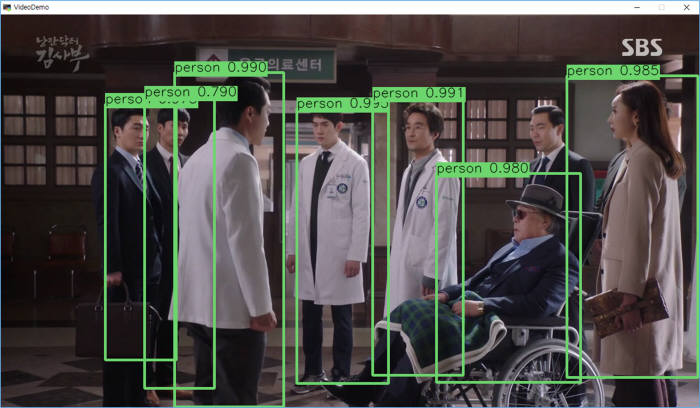

시각지능 기술은 언어 기반 정보에 비해 처리해야 할 데이터 용량이 훨씬 크기 때문에 AI 분야에서도 쉽지 않은 도전 과제다. 기술 구현을 위한 첫 단계는 객체 탐지 기능이다. 영상에 들어 있는 수많은 객체 가운데 원하는 것만 가려내는 기능이다.

ETRI가 개발하는 `딥뷰`는 용도에 따라 적게는 수십 가지에서 많게는 200가지에 이르는 객체를 인식할 수 있다. 탐지 객체 가지 수를 줄이면 그만큼 정확도는 높아진다. 지금까지 확보한 기술로는 최대 48%의 정확도를 보인다. 지난해 말 기준 세계 최고 수준의 탐지 정확도는 66%다.

ETRI 연구팀은 `딥러닝` 지도 학습으로 딥뷰의 탐지 기능을 높였다. 객체별로 최대 1만장의 사진을 학습시키고 있다.

딥뷰는 최근 탐지한 객체가 움직이는 의미를 추론하는 단계까지 개발됐다. 행동하는 방향이나 다른 객체와의 상호작용을 분석하는 수준이다. 자체 개발한 추론 엔진을 적용, 추론 정확도를 높이고 있다. `목적지로 출발하다` `도착하다` `차에 탑승하다` `물건을 들다`와 같은 형태로 행동을 파악할 수 있다. 다음 달까지 15개 행동 파악 기능을 갖출 예정이다.

딥뷰 기술을 활용하면 범죄 용의자를 추적하는 지능형 폐쇄회로(CC)TV를 비롯한 사물인터넷(IoT), 자율주행자동차, 지능형 로봇에 탑재해 주변 환경을 인식하는 기능을 부여할 수 있다.

유튜브 같은 동영상 플랫폼에 적용하면 수많은 영상 가운데 사용자가 원하는 장면, 인물 정보만을 추려서 검색하는 것도 가능하다.

연구팀은 올해 분석 정확도를 높이고 영상 분석 시간을 줄이는 데 집중, 내년부터 기술 상용화 단계에 들어간다는 목표를 세웠다.

박 그룹장은 “시각지능은 기존의 언어, 문자 기반 AIO보다 개발하기 어려운 차세대 기술”이라면서 “아직 갈 길이 멀지만 일단 개발만 되면 삶의 양상을 크게 바꾸는 계기가 될 것”이라고 설명했다.

대전=김영준기자 kyj85@etnews.com